Nhiều doanh nghiệp hiện muốn chạy AI để xử lý dữ liệu nội bộ như hợp đồng, tài liệu hoặc dữ liệu khách hàng. Tuy nhiên, gửi dữ liệu này qua các API AI công khai như ChatGPT hay Gemini không phải lúc nào cũng an toàn.

Vì vậy, giải pháp ngày càng phổ biến là chạy Local LLM trên VPS riêng để kiểm soát toàn bộ dữ liệu.

Nhưng khi triển khai thực tế, một câu hỏi rất hay gặp là: nên dùng VPS CPU thông thường hay VPS GPU để chạy AI?

Chọn sai hạ tầng có thể khiến hệ thống chạy rất chậm hoặc chi phí tăng gấp nhiều lần.

Bài viết này sẽ phân tích chi tiết hiệu năng, chi phí và trường hợp sử dụng của từng loại VPS để bạn chọn đúng hạ tầng cho hệ thống AI của mình.

Tại sao doanh nghiệp SME nên chạy Local LLM trên VPS riêng?

Việc chuyển hướng từ dùng API dịch vụ đám mây công cộng sang chạy LLM mã nguồn mở trên máy chủ ảo (VPS) riêng biệt mang lại một chiến lược lợi ích kép cho doanh nghiệp.

Tiết kiệm chi phí và đạt điểm hòa vốn nhanh chóng

Nhiều người lầm tưởng tự chạy AI sẽ vô cùng tốn kém. Thực tế, đối với các SME có khối lượng công việc vừa phải (dưới 10 triệu token/tháng), việc tự lưu trữ (self-hosting) là một bài toán kinh tế xuất sắc.

Nếu bạn triển khai các mô hình mã nguồn mở cỡ nhỏ và vừa (dưới 30 tỷ tham số như Qwen3-30B hay EXAONE 4.0 32B) trên các dòng card đồ họa cấp tiêu dùng mạnh mẽ (như RTX 3090, 4090), doanh nghiệp có thể đạt điểm hòa vốn (Break-even point) chỉ trong vòng 0,3 đến 3 tháng so với việc trả phí API hàng tháng cho OpenAI hay Anthropic. Việc dùng VPS giúp doanh nghiệp chuyển đổi linh hoạt chi phí biến đổi (OpEx) không lường trước được thành một khoản phí thuê bao hạ tầng cố định, loại bỏ hoàn toàn nỗi lo hóa đơn khổng lồ khi nhu cầu sử dụng AI của nhân viên tăng vọt.

Tham khảo thêm hướng dẫn chi tiết: Thuê VPS GPU chạy AI: Setup DeepSeek & Llama 3.3 bảo mật.

Làm chủ công nghệ, tối ưu độ trễ và tránh Vendor Lock-in

Khi phụ thuộc vào API, doanh nghiệp có rủi ro bị khóa chặt (Vendor Lock-in) với một nhà cung cấp. Nếu họ tăng giá, thay đổi chính sách quyền riêng tư hoặc ngừng dịch vụ, toàn bộ hệ thống của bạn sẽ tê liệt.

Sở hữu Local LLM trên VPS mang lại sự tự chủ chiến lược tuyệt đối. Bạn có thể tự do kết hợp mô hình với cơ sở dữ liệu nội bộ thông qua kỹ thuật RAG (Retrieval-Augmented Generation) để tạo ra chatbot chăm sóc khách hàng hay trợ lý pháp lý riêng biệt. Hơn nữa, việc đặt máy chủ VPS tại các Datacenter nội địa (Việt Nam) giúp giảm thiểu tối đa độ trễ mạng (latency), mang lại tốc độ phản hồi tức thì cho người dùng cuối so với việc phải gọi API vòng quanh thế giới.

Giải quyết triệt để rủi ro pháp lý với Nghị định 13/2023/NĐ-CP

Tại Việt Nam, rủi ro lớn nhất của việc dùng API AI công khai không chỉ là mất bí mật kinh doanh, mà là vi phạm pháp luật. Việc tự chạy Local LLM trên VPS trong nước là tấm khiên pháp lý vững chắc nhất hiện nay.

Ngăn chặn vi phạm chuyển dữ liệu cá nhân ra nước ngoài

Theo Điều 25 của Nghị định 13/2023/NĐ-CP, bất kỳ hành vi nào chuyển dữ liệu cá nhân của công dân Việt Nam ra khỏi lãnh thổ (kể cả việc đẩy dữ liệu lên API của máy chủ nước ngoài để xử lý) đều bắt buộc doanh nghiệp phải lập Hồ sơ đánh giá tác động và nộp cho Cục An ninh mạng (A05, Bộ Công an) trong vòng 60 ngày.

Khi dùng API của ChatGPT hay Claude, bạn đang kích hoạt điều khoản này một cách thụ động. Tuy nhiên, bằng cách thuê VPS có máy chủ vật lý đặt ngay tại Việt Nam, dữ liệu được đảm bảo nguyên tắc Data Residency (Lưu trú dữ liệu nội địa). Doanh nghiệp hoàn toàn né được gánh nặng thủ tục hành chính phức tạp và chi phí tuân thủ đắt đỏ.

Đảm bảo quyền kiểm soát và xóa dữ liệu trong 72 giờ

Nghị định 13 quy định rõ: Chủ thể dữ liệu (khách hàng, nhân viên) có quyền yêu cầu doanh nghiệp xóa dữ liệu của họ trong vòng 72 giờ.

Nếu bạn lỡ đẩy thông tin khách hàng vào API của bên thứ ba, bạn gần như không có quyền lực để ép hệ thống đám mây khổng lồ đó tìm và xóa vĩnh viễn dữ liệu của một cá nhân trong thời hạn ngắn như vậy. Ngược lại, với Local LLM trên VPS, doanh nghiệp nắm toàn quyền quản trị cơ sở dữ liệu (Database) và nhật ký hệ thống (System logs). Quản trị viên có thể truy xuất, cô lập hoặc xóa bỏ thông tin cá nhân một cách chính xác theo đúng yêu cầu của pháp luật.

Để theo dõi và giám sát hệ thống hiệu quả, SysAdmin có thể xem bài viết Cách dùng journalctl để xem log và gỡ lỗi (Troubleshoot VPS Linux).

Tuân thủ Luật An ninh mạng và minh bạch giải trình

Nghị định 53/2022/NĐ-CP (hướng dẫn Luật An ninh mạng) cũng nhấn mạnh yêu cầu lưu trữ dữ liệu người dùng tại Việt Nam. Đồng thời, khi có sự cố lộ lọt, doanh nghiệp phải báo cáo cơ quan chức năng chậm nhất trong 72 giờ.

Hạ tầng VPS riêng biệt cho phép doanh nghiệp thiết lập các hệ thống kiểm toán (Auditing), giám sát lưu lượng mạng ra vào (Inbound/Outbound traffic) và tường lửa độc lập. Sự minh bạch này giúp doanh nghiệp chứng minh được sự tuân thủ và sẵn sàng giải trình trước cơ quan thanh tra khi cần thiết, tránh mức phạt thảm họa có thể lên tới 5% tổng doanh thu theo các dự thảo pháp luật mới.

Kiến trúc xử lý AI: Vì sao băng thông bộ nhớ là nút thắt cổ chai?

Để hiểu rõ tại sao hiệu năng giữa các phần cứng lại chênh lệch lớn khi chạy AI, chúng ta cần đi sâu vào kiến trúc vi xử lý và cách chúng xử lý các ma trận toán học khổng lồ của LLM.

Khác biệt cốt lõi: CPU (tuần tự) vs GPU (song song)

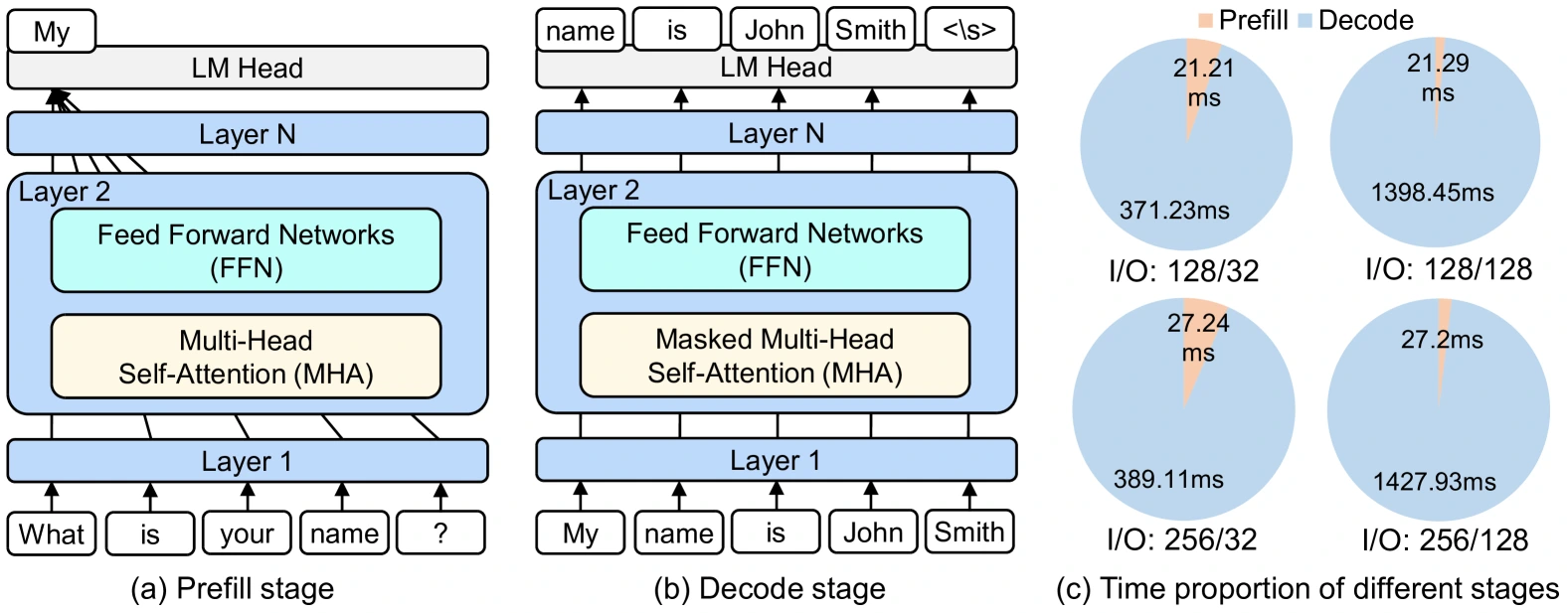

Mô hình ngôn ngữ lớn (Transformer) hoạt động dựa trên mạng nơ-ron nhân tạo, với thành phần cốt lõi là các phép nhân ma trận (General Matrix Multiplication, GEMM).

- CPU (Kiến trúc xử lý tuần tự): CPU giống như một nhóm nhỏ các giáo sư toán học lỗi lạc. Họ có thể giải quyết các phương trình logic cực kỳ rắc rối với tốc độ phản hồi chớp nhoáng. Tuy nhiên, họ làm việc theo trình tự (từng việc một). CPU rất xuất sắc trong việc chạy hệ điều hành, quản lý cơ sở dữ liệu, nhưng lại bị quá tải khi phải tính toán hàng tỷ phép nhân nhỏ lẻ cùng lúc.

- GPU (Kiến trúc xử lý song song): GPU không thông minh bằng CPU trong các tác vụ logic rẽ nhánh, nhưng nó sở hữu hàng ngàn lõi chuyên dụng (như CUDA cores hay Tensor cores). Nó giống như một đội quân 10.000 công nhân. Khi đối mặt với phép nhân ma trận của LLM, GPU chia nhỏ bài toán và cho 10.000 công nhân giải quyết đồng thời. Sức mạnh tính toán song song này giúp GPU nhanh hơn CPU từ 10 đến 100 lần trong lĩnh vực Deep Learning.

Băng thông bộ nhớ (Memory Bandwidth): kẻ quyết định cuộc chơi

Có một nghịch lý trong suy luận AI (Inference): Khả năng tính toán của lõi xử lý thường không phải là giới hạn, mà giới hạn nằm ở tốc độ truyền dữ liệu vào lõi.

Quá trình sinh văn bản (Decode phase) của LLM hoạt động theo kiểu tự hồi quy, nó tạo ra từng từ (token) một. Để tạo ra một token, hệ thống phải nạp toàn bộ trọng số (weights) khổng lồ của mô hình từ bộ nhớ vào lõi tính toán. Quá trình này có cường độ số học thấp nhưng lại khát khao dữ liệu tột cùng.

- Nút thắt của CPU: Chạy LLM trên CPU đồng nghĩa với việc dùng RAM hệ thống (DDR4/DDR5). Băng thông RAM chỉ đạt mức vài chục đến hơn 100 GB/s. Các lõi CPU mạnh mẽ sẽ phải nhàn rỗi để chờ dữ liệu chậm chạp truyền từ RAM lên.

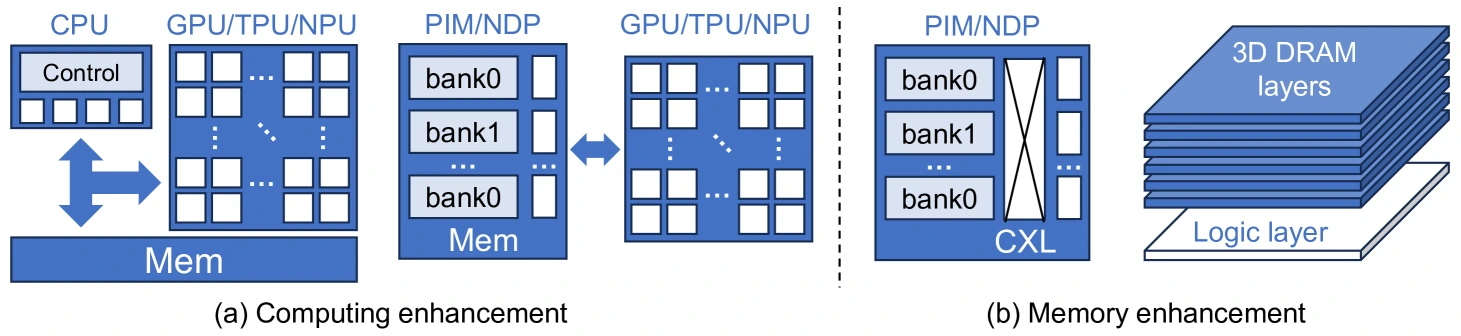

- Vũ khí của GPU: VRAM trên card đồ họa giải quyết triệt để nút thắt này. Ví dụ, siêu chip trung tâm dữ liệu NVIDIA H100 (SXM5) được trang bị bộ nhớ HBM3, mang lại băng thông siêu tốc lên tới hơn 3 TB/s (3000 GB/s). Ngay cả card tiêu dùng như RTX 5090 cũng sở hữu băng thông GDDR7 đạt 1792 GB/s.

Băng thông truyền tải khổng lồ này chính là lý do khiến việc thuê VPS GPU trở thành tiêu chuẩn bắt buộc cho các dự án AI quy mô lớn.

Benchmark thực tế: Khi nào CPU vượt GPU và khi nào bắt buộc thuê VPS GPU?

Dựa trên các báo cáo hiệu năng (Benchmark), tốc độ suy luận đo bằng Tokens/giây (t/s) có sự phân hóa đáng kinh ngạc tùy thuộc vào quy mô (số lượng tham số) của mô hình AI.

Nhóm siêu nhỏ (< 1 tỷ tham số): sự trỗi dậy bất ngờ của CPU

Một nghiên cứu đột phá mang tên Challenging GPU Dominance đã chỉ ra rằng: Đối với môi trường Edge AI (AI tại biên/thiết bị) chạy các mô hình siêu nhỏ như Llama 3.2 1B hay Qwen 0.5B (định dạng F16), CPU đa luồng thực sự đánh bại GPU!

- Tốc độ: CPU đa luồng đạt khoảng 17 tokens/s, trong khi GPU chỉ ở mức 12.8 tokens/s. Trên các chip PC cao cấp, CPU còn vọt lên 37 – 70 tokens/s.

- Nguyên nhân kỹ thuật: Khi batch size = 1 và ma trận quá nhỏ, việc gọi lệnh cho GPU (gọi là Kernel Launch Overhead) và đồng bộ bộ nhớ tốn nhiều thời gian hơn cả việc tự tính toán. CPU bỏ qua được độ trễ khởi chạy này, giải quyết trực tiếp bài toán trên RAM và giành chiến thắng ngoạn mục.

Nhóm nhỏ & vừa (7B – 8B tham số): lãnh địa độc tôn của GPU

Bắt đầu từ quy mô này (ví dụ: Llama 3 8B, DeepSeek-R1-Distill), sức mạnh xử lý song song của GPU chính thức lên ngôi.

- VPS CPU: Chỉ đạt mức tốc độ thấp khoảng 8 – 10 tokens/s (hoặc 28-45 t/s nếu dùng CPU Server cao cấp bật tập lệnh AMX). Tốc độ này chỉ phù hợp để chạy ngầm, tóm tắt tài liệu ban đêm.

- VPS GPU (RTX 3090/4090): Đạt tốc độ xử lý cực nhanh từ 95 đến trên 160 tokens/s (nếu tối ưu hóa qua llama.cpp). Tốc độ này cho phép chatbot phản hồi lập tức, mượt mà hơn cả người thật gõ phím. Đây là phân khúc hiệu suất cao và tiết kiệm nhất cho doanh nghiệp SME.

Nhóm khổng lồ (70B+ tham số): yêu cầu hạ tầng chuyên nghiệp

Với các mô hình có trí thông minh vượt trội (như Llama 3 70B, Qwen 72B), rào cản lớn nhất là dung lượng VRAM (cần tối thiểu 40GB – 48GB VRAM cho bản nén 4-bit).

- VPS CPU: Quá tải, treo hệ thống (OOM – Out of Memory) hoặc chạy với tốc độ thấp (< 10 tokens/s) ngay cả trên các hệ thống Server đắt tiền.

- VPS GPU: Bắt buộc phải triển khai kiến trúc Multi-GPU (như ghép 2x RTX 3090) để đạt ~12 tokens/s. Đối với môi trường doanh nghiệp lớn (Production), việc thuê card trung tâm dữ liệu như NVIDIA A100 (80GB VRAM) là bắt buộc, mang lại tốc độ cơ sở ~90 tokens/s và khả năng xử lý hàng ngàn yêu cầu cùng lúc.

Phân tích TCO: vì sao dùng GPU lại tiết kiệm hơn CPU cho AI nặng?

Nhiều Giám đốc Tài chính (CFO) e ngại việc thuê GPU vì giá thuê theo giờ luôn cao hơn CPU. Nhưng nếu phân tích theo bài toán Tổng chi phí sở hữu (TCO) và Lợi tức đầu tư (ROI), kết quả lại hoàn toàn ngược lại.

Bảng giá thuê tham khảo trên thị trường

- VPS CPU (Thuê theo tháng): Rất rẻ, từ 50.000 VNĐ – 115.000 VNĐ/tháng cho gói siêu nhỏ, hoặc khoảng 200.000 – 500.000 VNĐ/tháng cho cấu hình Web/SaaS phổ thông.

- Bạn có thể xem thêm danh sách TOP VPS nước ngoài, VPS Việt NAM bán chạy nhất để khảo giá thị trường.

- VPS GPU (Thuê theo giờ / Spot Instances): Với hình thức Pay-as-you-go (dùng bao nhiêu trả bấy nhiêu), bạn có thể thuê một hệ thống máy chủ AI hiệu suất cao như RTX 3090 với giá chỉ khoảng $0.15 – $0.22/giờ (tương đương 4.000 – 5.500 VNĐ/giờ) trên các nền tảng đám mây phân tán.

TCO thực tế: sức mạnh của thời gian và điện năng

Đơn vị đo lường chi phí trong AI không phải là USD/Tháng, mà là USD cho 1 triệu Token hoặc USD cho 1 đợt huấn luyện.

- Rút ngắn thời gian tính phí: Một tác vụ phân tích dữ liệu lớn trên CPU có thể chạy ròng rã mất 10 ngày. Nếu đẩy lên Cloud GPU, công việc hoàn thành trong chưa tới 16 giờ (nhanh hơn 15 lần). Dù giá thuê GPU/giờ đắt gấp 5 lần CPU, nhưng hóa đơn cuối cùng (Thời gian thực thi x Đơn giá) của GPU lại rẻ hơn rất nhiều.

- Hiệu suất trên mỗi Watt: Nếu doanh nghiệp tự build máy chủ vật lý, điện năng và chi phí tản nhiệt cho một cụm 20 máy chủ CPU (để đạt thông lượng bằng 1 máy chủ GPU) sẽ ăn mòn toàn bộ lợi nhuận. GPU cung cấp mật độ tính toán cực cao trên mỗi Watt điện.

- Chi phí cơ hội (Opportunity Cost): Tốc độ của GPU giúp các kỹ sư R&D thử nghiệm mô hình, tinh chỉnh LoRA (Fine-tuning) và ra mắt sản phẩm chỉ trong vài ngày thay vì vài tuần. Việc đưa Chatbot AI ra phục vụ khách hàng sớm hơn sẽ sinh ra doanh thu bù đắp hoàn toàn chi phí hạ tầng.

Tối ưu 70-80% chi phí với chiến lược kiến trúc lai (Hybrid Architecture)

Làm sao để vừa có hệ thống tính toán mạnh mẽ, vừa không phải trả tiền thuê GPU 24/7 (đặc biệt là ban đêm khi nhân viên đi nghỉ)? Các chuyên gia DevOps sử dụng một phương pháp gọi là Kiến trúc Lai (Hybrid Architecture), phân bổ tải trọng cực kỳ thông minh:

- Frontend Server (Đảm nhận bởi VPS CPU): Doanh nghiệp thuê một VPS CPU giá tối ưu (~150.000 VNĐ/tháng) để chạy giao diện ứng dụng (như Open WebUI) và quản lý cơ sở dữ liệu chat. Máy chủ này chạy 24/7, giúp nhân viên luôn có thể đăng nhập, tìm kiếm tài liệu nội bộ, và xem lại lịch sử làm việc.

- Backend Server (Đảm nhận bởi VPS GPU): Đây là bộ vi xử lý trung tâm chứa mô hình LLM khổng lồ. Backend chỉ kết nối với Frontend qua API nội bộ. Doanh nghiệp sẽ cấu hình để thuê VPS GPU theo dạng Spot Instance (máy chủ giao ngay). Máy chủ GPU này chỉ khởi động và tính tiền khi có một câu lệnh (prompt) thực sự được nhân viên gõ vào giao diện. Xử lý xong, nó tự động tắt hoặc vào trạng thái ngủ để ngừng tính phí.

Bằng kiến trúc thông minh này, doanh nghiệp có thể cắt giảm từ 70% đến 80% ngân sách hạ tầng so với việc giữ một máy chủ GPU Dedicated chạy liên tục không ngừng nghỉ.

Biến VPS thành pháo đài bảo mật theo tiêu chuẩn Zero Trust

Cuối cùng, phần cứng mạnh mẽ không có ý nghĩa gì nếu bảo mật bị bỏ ngỏ. Để biến máy chủ của bạn thành một kho lưu trữ an toàn thực thụ khi chạy Local LLM, quản trị viên hệ thống cần triển khai mô hình Zero Trust (Không tin tưởng bất kỳ ai) với 4 lớp phòng thủ:

- Môi trường độc lập (Dedicated / vGPU & TEE): Tuyệt đối không chạy AI trên Shared Hosting. Hãy sử dụng Dedicated Server (Máy chủ vật lý) hoặc phân vùng vGPU độc lập để ngăn chặn nguy cơ tin tặc xâm nhập chéo từ máy chủ lân cận sang máy bạn. Ở cấp độ cao cấp hơn, có thể dùng công nghệ TEE (Trusted Execution Environments – như Intel SGX) để tạo ra các vùng an toàn mã hóa dữ liệu ngay cả khi nó đang nằm trên thanh RAM đang hoạt động.

- Mạng nội bộ (Private VLAN) & Kiểm soát lưu lượng: Không bao giờ gán địa chỉ IP Public (Internet) trực tiếp cho cổng chạy LLM (ví dụ port 11434 của Ollama). Đưa máy chủ AI vào một mạng LAN ảo riêng biệt (Private VLAN) với các IP nội bộ không định tuyến được. Mọi kết nối từ Internet nhắm vào máy chủ LLM đều bị tường lửa thả drop ngay lập tức.

- Đường hầm mã hóa VPN: Vì máy chủ LLM đã bị cô lập hoàn toàn, kênh kết nối duy nhất để truy cập vào quản trị hoặc cho phép Frontend Server gọi API là thông qua một đường hầm VPN (như IPsec hoặc WireGuard). Mọi dữ liệu truyền tải đều được xáo trộn mã hóa, ngăn chặn hoàn toàn việc nghe lén mạng.

- Mã hóa ổ đĩa tại chỗ (LUKS): Đây là tuyến phòng thủ cuối cùng bảo vệ Dữ liệu đang nghỉ (Data-at-Rest). Toàn bộ phân vùng chứa trọng số mô hình LLM, cơ sở dữ liệu Vector và lịch sử chat phải được mã hóa bằng tiêu chuẩn LUKS (Linux Unified Key Setup). Nếu kẻ gian đột nhập Datacenter trộm ổ cứng vật lý, chúng cũng chỉ thu được một đống dữ liệu vô nghĩa vì không có khóa giải mã (Decryption Key).

Tham khảo thêm xu hướng Bảo mật VPS 2026: Chống Harvest Now, Decrypt Later bằng chuẩn FIPS 203.

Kết luận

Hành trình tích hợp AI vào vận hành doanh nghiệp là một bước tiến mang tính cách mạng, nhưng nó phải được xây dựng trên một nền móng hạ tầng vững chắc và an toàn.

Nếu bạn chỉ cần xử lý các tác vụ cực nhỏ (Edge AI), thử nghiệm các mô hình dưới 1 tỷ tham số, hoặc chạy các luồng xử lý dữ liệu ngầm không yêu cầu thời gian thực, VPS CPU là một lựa chọn tiết kiệm đáng cân nhắc.

Tuy nhiên, đối với 90% nhu cầu thực tế của doanh nghiệp SME hiện nay, từ việc triển khai Chatbot chăm sóc khách hàng phản hồi tức thì, đến xây dựng trợ lý AI phân tích hàng ngàn trang tài liệu pháp lý (RAG) với các mô hình mạnh mẽ từ 7B đến 30B tham số, việc quyết định thuê VPS GPU là điều bắt buộc.

Đầu tư vào hạ tầng GPU, kết hợp cùng chiến lược vận hành Hybrid thông minh và thiết lập bảo mật Zero Trust, không chỉ mang lại hiệu suất làm việc vượt trội mà còn giúp doanh nghiệp xây dựng một pháo đài dữ liệu bất khả xâm phạm. Đó chính là nước cờ khôn ngoan nhất để tuân thủ tuyệt đối các quy định pháp luật hiện hành và tối ưu hóa tối đa tỷ suất lợi nhuận (ROI) trong kỷ nguyên Trí tuệ nhân tạo.

Tài liệu tham khảo

- A Cost-Benefit Analysis of On-Premise Large Language Model Deployment: Breaking Even with Commercial LLM Services

- Challenging GPU Dominance: When CPUs Outperform for On-Device LLM Inference

- Large Language Model Inference Acceleration: A Comprehensive Hardware Perspective

- NVIDIA Hopper Architecture In-Depth | NVIDIA Technical Blog