Bạn vừa deploy một dàn AI Agent cực kỳ mạnh mẽ. Mọi thứ chạy trơn tru trên local, các agent tự động phân tích dữ liệu, gọi LLM API, tra cứu web và tổng hợp report. Nhưng ngay khi đẩy lên môi trường production và scale lên vài trăm request mỗi phút, ác mộng bắt đầu ập đến. Đầu tiên là hàng loạt lỗi HTTP 429 Too Many Requests đỏ rực màn hình do dính rate-limit từ nhà cung cấp. Tệ hơn nữa, vài ngày sau, team Security gõ cửa vì phát hiện hàng loạt luồng traffic dò quét cổng (port scanning) nhắm thẳng vào IP public của server doanh nghiệp bạn.

Chuyện gì đã xảy ra? Đơn giản là các AI Agent của bạn đã quá hồn nhiên khi gọi API ra bên ngoài mà không được che chắn, phơi bày toàn bộ IP gốc của hạ tầng lõi cho thế giới internet. Đó chính là lúc việc cấu hình Proxy Socks5 cho AI Agent không còn là một lựa chọn có thì tốt, mà trở thành tấm khiên bắt buộc để sinh tồn.

Vậy chính xác thì việc lộ IP gốc mang lại những rủi ro chí mạng nào? Làm thế nào để cấu hình SOCKS5 chuẩn xác mà không dính bẫy framework của LangChain hay HTTPX? Hãy cùng mổ xẻ chi tiết.

Nỗi đau thực tế: Khi AI Agent hồn nhiên để lộ IP gốc và dính Rate-limit

Các AI Agent (build bằng LangChain, CrewAI, AutoGen…) về bản chất là các đoạn code thực thi vòng lặp tự động hóa. Chúng giao tiếp liên tục với các external service như OpenAI, Anthropic, Weather API, hay các database của đối tác.

Reverse attack và rủi ro bị fingerprinting từ các outbound API call

Mỗi một request mà AI Agent gửi đi đều mang theo địa chỉ IP gốc của server nội bộ trong gói tin TCP/IP. Khi đó, external service sẽ ghi log lại IP này. Nếu Agent của bạn tương tác với một endpoint không an toàn, IP public của doanh nghiệp bạn sẽ rơi vào tay kẻ xấu. Kẻ tấn công có thể sử dụng IP này để:

- Fingerprinting (Nhận diện hạ tầng): Dò quét các port đang mở, xác định hệ điều hành và các dịch vụ đang chạy trên server.

- Tấn công ngược (Reverse Attack): Khai thác lỗ hổng zero-day trên firewall hoặc web server nội bộ.

- DDoS có chủ đích: Bơm hàng chục Gbps traffic rác thẳng vào IP lõi, đánh sập toàn bộ hệ thống của doanh nghiệp.

Ám ảnh IP block và Rate-limit khi scale hệ thống

Khác với người dùng thông thường, AI Agent có tốc độ thu thập dữ liệu và gọi API cực kỳ cao. Khi 50 agents cùng đập request vào một dịch vụ tìm kiếm bên thứ ba từ một IP duy nhất, thuật toán Anti-bot của đối tác sẽ giương cờ đỏ (red flag), đánh dấu IP của bạn là botnet. Kết quả là IP bị block thẳng tay, và toàn bộ luồng nghiệp vụ AI của công ty bị đóng băng.

Để xử lý bài toán này ở quy mô lớn, doanh nghiệp thường phải kết hợp dùng Datacenter Proxy chống rate limit.

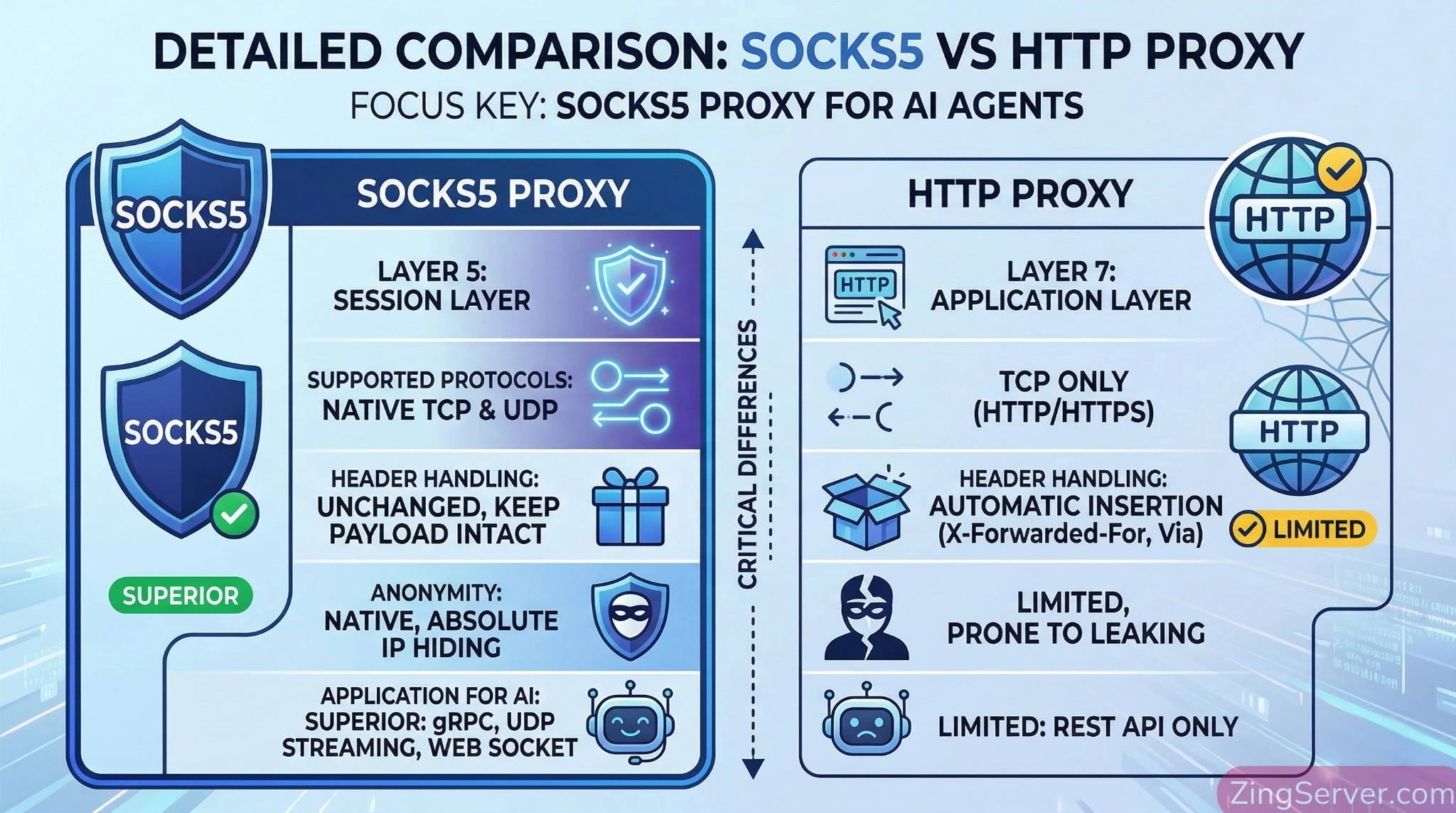

Hiểu đúng bản chất mạng: SOCKS5 vs HTTP Proxy Tunneling

Nhiều developer tặc lưỡi: Thế thì ném cho nó cái HTTP Proxy là xong. Tuy nhiên, trong môi trường AI đòi hỏi khắt khe, bạn cần hiểu rõ cơ chế dưới nền để chọn đúng công cụ.

Để nắm rõ sự khác biệt căn bản, bạn có thể tham khảo bài viết so sánh chi tiết SOCKS5 và HTTP(s) Proxy.

Sự thật về HTTP Tunneling và bắt tay TLS trực tiếp

Thực tế, HTTP Proxy hoàn toàn có thể xử lý an toàn các luồng HTTPS thông qua cơ chế TUNNEL (Tạo đường hầm). Ở cơ chế này, proxy chỉ đóng vai trò thiết lập một kết nối mạng TCP đến server đích thay cho bạn. Sau khi kết nối TCP được mở, HTTPX client sẽ tái sử dụng chính đường hầm này để thực hiện quá trình bắt tay bảo mật (TLS handshake) trực tiếp với máy chủ đích.

Điều này có nghĩa là dữ liệu vẫn được mã hóa end-to-end, và HTTP proxy hoàn toàn không thể đọc được nội dung gói tin HTTPS của bạn.

Tại sao SOCKS5 (Layer 5) vẫn là chân ái cho AI Agent?

Mặc dù HTTP Tunneling giải quyết được bài toán bảo mật HTTPS, nhưng SOCKS5 vẫn ưu việt hơn ở cấp độ kiến trúc hệ thống:

- Hoạt động native ở Layer 5: SOCKS5 sinh ra để định tuyến ở tầng Session Layer. Nó là một đường ống truyền dữ liệu thô trung thành, không tốn tài nguyên (overhead) để phân tích hay đóng gói lại header như HTTP Proxy.

- Hỗ trợ hoàn hảo UDP & gRPC: AI Agent hiện đại không chỉ dùng REST API. Khi Agent stream audio/video realtime (yêu cầu UDP) hoặc giao tiếp tốc độ cao qua gRPC, WebSocket, SOCKS5 xử lý mượt mà, trong khi HTTP Proxy sẽ gặp rào cản cực lớn.

- Ngăn chặn can thiệp Header: Các HTTP Proxy (đặc biệt khi cấu hình sai) hay tự động chèn trường

X-Forwarded-For, làm lộ IP gốc. SOCKS5 giữ nguyên trạng payload, đảm bảo bảo mật IP hoàn toàn.

Thực chiến: Cấu hình Proxy Socks5 cho AI Agent (xử lý dứt điểm các gotcha)

Lý thuyết đã xong, giờ là lúc xắn tay áo lên. Các framework AI hiện tại đang thay đổi liên tục, và dưới đây là những kinh nghiệm xương máu để cấu hình proxy an toàn nhất.

Cài đặt dependency của bên thứ ba để HTTPX hỗ trợ giao thức SOCKS:

pip install "httpx[socks]"Cấu hình httpx và cú lừa Proxy URL cho HTTPS

Một gotcha chí mạng mà tài liệu HTTPX đã cảnh báo: Khi bạn thiết lập cấu hình proxy thông thường cho khóa https://, giá trị URL của proxy thường bắt buộc phải sử dụng scheme http:// (ví dụ: "https://": "http://localhost:8031"). Đây không phải là lỗi đánh máy! Lý do là hầu hết proxy server yêu cầu kết nối khởi tạo ban đầu qua giao thức HTTP thuần túy trước khi nâng cấp lên đường hầm TCP.

Tuy nhiên, đối với SOCKS5, bạn cấu hình đồng nhất scheme proxy như sau:

import httpx

proxies = {

"http://": "socks5h://user:pass@proxy-ip:1080",

"https://": "socks5h://user:pass@proxy-ip:1080"

}

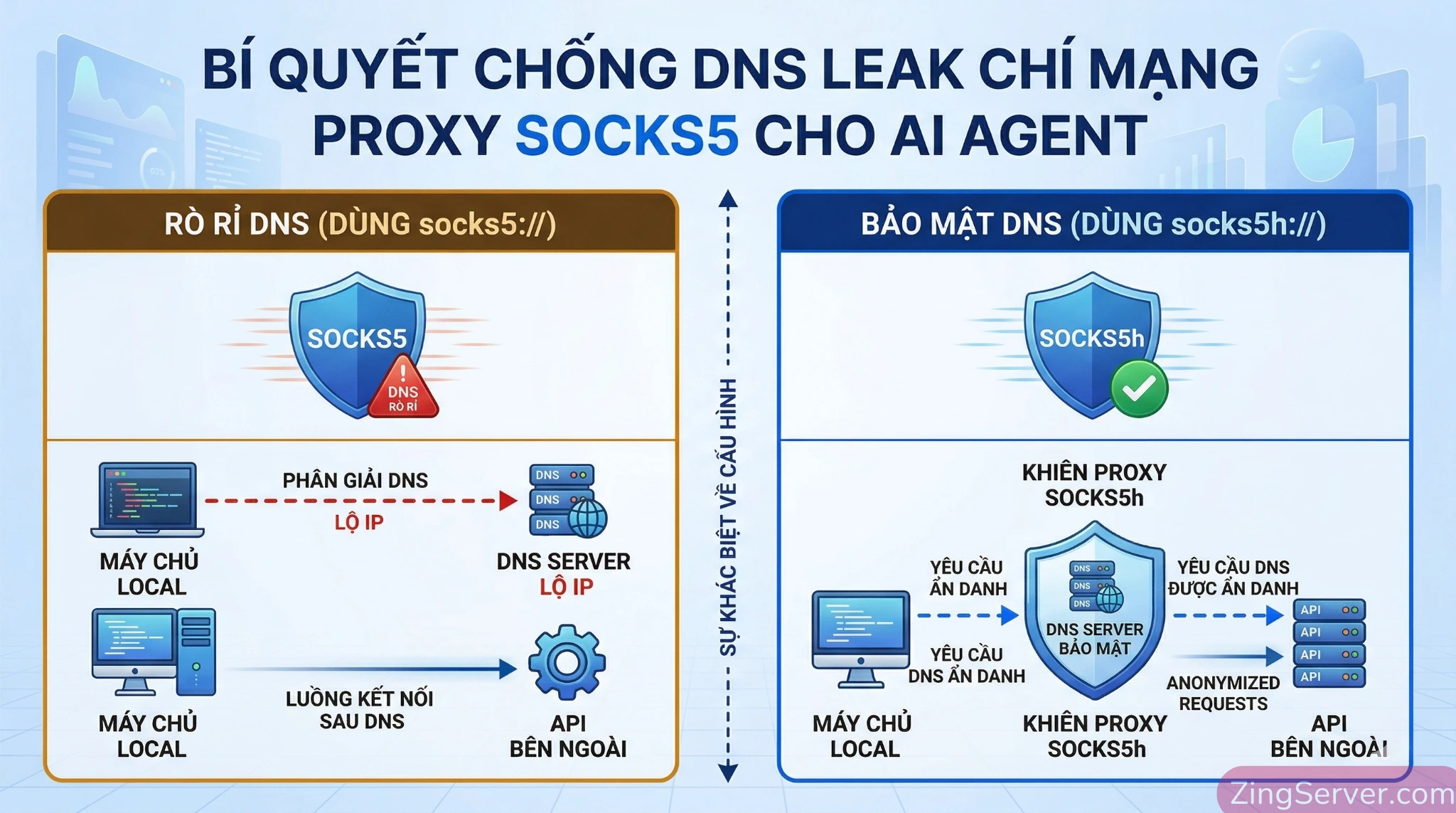

client = httpx.Client(proxies=proxies)Ngăn chặn DNS Leak: Tuyệt đối phải dùng socks5h://

Bạn có để ý chữ h trong URL socks5h:// ở trên không? Đây là lằn ranh giữa an toàn và rò rỉ dữ liệu.

- Nếu dùng

socks5://: Tên miền sẽ được phân giải (DNS) tại máy local của bạn trước. ISP hoặc hacker theo dõi mạng nội bộ sẽ biết chính xác Agent đang gọi đến domain nào (api.openai.com), gây rò rỉ DNS (DNS Leak). - Nếu dùng

socks5h://: Việc phân giải DNS sẽ được đẩy hoàn toàn qua đường hầm và do máy chủ Proxy thực hiện. Máy chủ nội bộ của bạn sẽ im lặng tuyệt đối ở tầng mạng.

Vượt ải openai-python v1.13.4 và lỗi đóng client của framework

Đây là lỗi làm rụng tóc nhiều developer nhất thời gian qua. Nhiều hướng dẫn cũ bảo bạn truyền thẳng httpx.AsyncClient vào LangChain. Đừng làm vậy trên Production vì 2 nguyên nhân cốt lõi:

- Lỗi Type-Check từ OpenAI: Từ bản

openai-python v1.13.4, thư viện này dùng hàmisinstance()để kiểm tra cực kỳ khắt khe xem tham sốhttp_clientcó đích xác là một thể hiện củahttpx.Clienthay không. Việc LangChain bọc (wrap) hoặc truyền các instance tùy chỉnh không khớp chuẩn sẽ lập tức văng lỗiTypeError. - Framework tự động đóng Connection (Ví dụ: Strands-agents): Để tránh việc chia sẻ kết nối (connection sharing) chéo giữa các event loop của

asyncio, framework sẽ tự động đóng (close) HTTP client ngay sau request đầu tiên. Do đó, các request tiếp theo trong vòng lặp sẽ thất bại toàn tập vì client đã nằm ở trạng thái closed state.

Nhiều người nghĩ dùng biến môi trường (ALL_PROXY) sẽ giải quyết được, nhưng thực tế, biến môi trường bị hạn chế hỗ trợ SOCKS5 native trong các container Docker và thiếu sự kiểm soát cấu hình nâng cao.

Giải pháp Thực chiến – Mô hình Client Factory: Thay vì truyền một client tĩnh, cấu trúc mã của bạn cần áp dụng Factory Pattern để sinh ra các client không bị đóng hoặc tạo mới client an toàn cho mỗi ngữ cảnh:

import httpx

from openai import AsyncOpenAI

def get_proxy_client():

"""Factory function tạo ra một AsyncClient mới kèm proxy chuẩn."""

return httpx.AsyncClient(

proxies={"all://": "socks5h://user:pass@proxy-ip:1080"},

transport=httpx.AsyncHTTPTransport(retries=3)

)

# Khi khởi tạo Agent hoặc OpenAI Client trong worker/loop:

client = AsyncOpenAI(

api_key="your_api_key",

http_client=get_proxy_client() # Cấp phát một pool hoàn toàn mới, an toàn cho asyncio

)Mô hình này giúp tái sử dụng connection pool hiệu quả trong phạm vi một event loop, đồng thời quản lý tập trung các chính sách mạng (timeout, retries).

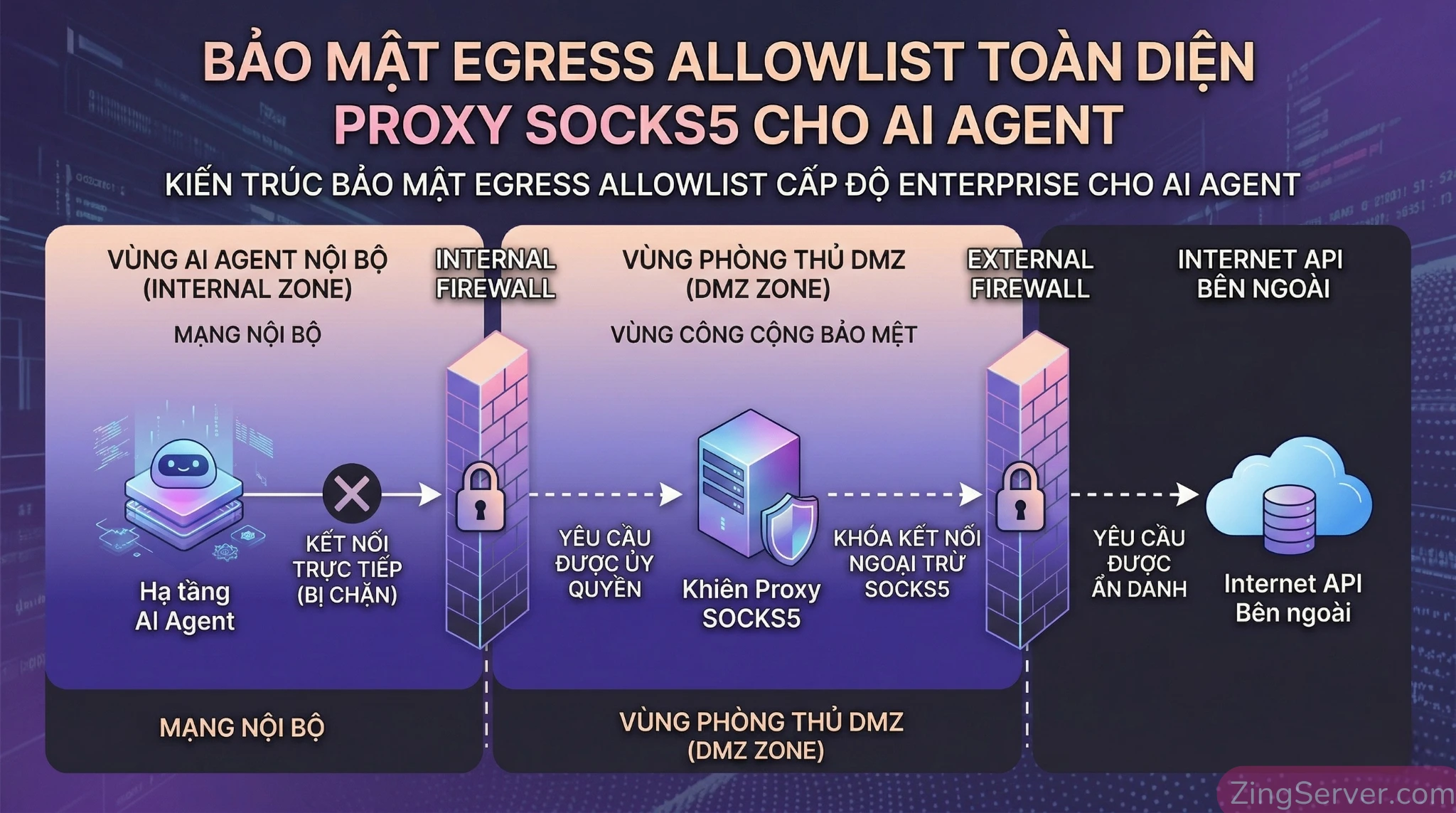

Kiến trúc bảo mật Outbound toàn diện (Enterprise-grade)

Thiết lập Proxy trong code mới chỉ là một nửa chặng đường. Để hạ tầng đạt chuẩn, team DevOps cần khóa chặt mạng lưới.

Egress Allowlist: Khóa chặt firewall, chỉ mở luồng qua Proxy

Nếu bạn chỉ cấu hình trong code, rủi ro cấu hình sai vẫn luôn rình rập. Nguyên tắc bảo mật Zero Trust yêu cầu chúng ta cấu hình tường lửa (Security Groups/iptables) với chính sách Default Deny Outbound:

- Block toàn bộ kết nối ra Internet trực tiếp từ máy chủ chạy AI Agent.

- Chỉ mở duy nhất (Allow) kết nối đến địa chỉ IP và Port của SOCKS5 Proxy nội bộ.

Bằng cách này, nếu code lỗi, request sẽ bị firewall chặn đứng ngay lập tức, không cho IP gốc có cơ hội lọt ra ngoài.

Tự build (Dante Server) vs thuê hạ tầng SOCKS5 Dedicated

- Tự Build (Dante): Triển khai phần mềm

dante-servertrên VPS Linux. Chi phí rẻ, kiểm soát 100% dữ liệu nội bộ. Tuy nhiên, bạn phải tự đối phó với việc IP bị đưa vào danh sách đen. - Sử dụng dịch vụ Proxy Pool Doanh nghiệp: Mua các gói Proxy từ nhà cung cấp chuyên nghiệp. Ưu điểm là tính sẵn sàng cao, kết hợp tự động xoay vòng IP (Proxy Xoay) để các Agent thực hiện thu thập dữ liệu (Web Scraping) không bao giờ bị dính Rate-limit.

Checklist 5 bước trước khi đưa AI Agent lên Production

Trước khi tự tin nhấn nút Deploy hệ thống ra môi trường thực tế, hãy rà soát kỹ 5 bước sinh tử sau:

- Cài đặt Dependency: Đảm bảo

httpx[socks]đã có trongrequirements.txt. - Chống DNS Leak: Luôn sử dụng scheme

socks5h://trong chuỗi khai báo Proxy URL. - Quản lý vòng đời Client (Factory Pattern): KHÔNG dùng một client tĩnh tái sử dụng toàn cục. Hãy dùng hàm factory để khởi tạo

http_clientmới cho các phiên làm việc của AI framework, tránh lỗiTypeErrorvàClosed Connection. - Xác thực và Khóa Egress Firewall: SOCKS5 Server phải bắt buộc xác thực User/Pass + IP Whitelist. Firewall host phải chặn mọi outbound traffic không đi qua Proxy.

- Giám sát SIEM: Đẩy log của Proxy server về hệ thống trung tâm để phát hiện tức thì dấu hiệu Agent bị chiếm quyền gọi tới domain lạ.

Việc áp dụng kiến trúc Proxy Socks5 cho AI Agent không đơn thuần là để lách luật Rate-limit, mà là dựng lên một chiến hào vững chắc, tuân thủ nguyên tắc Zero Trust để bảo vệ hệ thống lõi. Hãy vận hành những nhân viên số của bạn một cách bảo mật và chuyên nghiệp nhất!

Câu hỏi thường gặp (FAQ)

1. Nên dùng SOCKS5 hay HTTP Proxy cho LangChain?

Ưu tiên SOCKS5. SOCKS5 hoạt động ở tầng thấp (Layer 5), hỗ trợ mọi giao thức (TCP, UDP, gRPC) và giữ nguyên payload. Trong khi đó, HTTP Proxy dễ tự động chèn header làm lộ IP gốc và hay gặp lỗi khi xử lý các kết nối phi tiêu chuẩn của AI.

2. Tại sao BẮT BUỘC phải dùng socks5h:// thay vì socks5://?

Chữ h quyết định nơi phân giải tên miền. Dùng socks5h:// sẽ ép hệ thống phân giải DNS tại máy chủ Proxy, bảo mật tuyệt đối. Nếu dùng socks5://, máy chủ local của bạn sẽ tự phân giải DNS, gây rò rỉ (DNS Leak) và lộ lịch sử truy cập cho nhà mạng.

3. Làm sao để fix lỗi TypeError openai-python v1.13.4 khi dùng Proxy?

Tuyệt đối KHÔNG truyền tĩnh http_client vào framework (như LangChain). Hãy dùng biến môi trường (export ALL_PROXY) ở cấp hệ điều hành, hoặc áp dụng Factory Pattern để cấp phát một client httpx hoàn toàn mới cho mỗi request, giúp vượt qua type-check và tránh lỗi framework tự động đóng connection.

4. Dùng thư viện httpx bị báo lỗi Connection Refused, xử lý sao?

Rà soát ngay 3 thủ phạm:

- Chưa cài dependency: Chạy lại lệnh

pip install "httpx[socks]". - Sai scheme: Cấu hình target HTTPS nhưng URL proxy không để

http://hoặcsocks5h://. - Tường lửa: Firewall/Security Group chưa mở port outbound (thường là 1080) cho IP Proxy.

5. SOCKS5 có làm tăng độ trễ (latency) khi LLM trả lời không?

Không, thậm chí có thể nhanh hơn HTTP Proxy. SOCKS5 không mất thời gian phân tích, bóc tách hay ghi đè các HTTP Header mà chỉ định tuyến gói tin thô, cực kỳ phù hợp cho các luồng dữ liệu trả về theo thời gian thực (Streaming) của LLM.

6. Làm sao để test chắc chắn AI Agent đã ẩn IP gốc?

Viết một script ngắn cho Agent gọi lệnh GET đến endpoint https://api.ipify.org?format=json. Nếu JSON trả về IP của máy chủ Proxy thay vì IP Public của doanh nghiệp bạn, cấu hình mạng đã an toàn.

7. AI Agent nên dùng Datacenter Proxy hay Residential Proxy?

- Datacenter Proxy: Tốc độ cao, giá rẻ, phù hợp để gọi các API chính thống (OpenAI, AWS).

- Residential Proxy (IP Dân cư): Bắt buộc dùng nếu Agent có nhiệm vụ thu thập dữ liệu (Web Scraping) để tránh bị các hệ thống Anti-bot (như Cloudflare) chặn đứng.